1. 首先zookeeper是什么 zookeeper是一个开放源代码的分布式应用程序协调服务,可以把它看成是整个集群的管理者,监视者。2. zookeeper能做什么 它可以实现诸如分布式应用配置管理、统一命名服务、状态同步服务、集群管理等功能。3. zookeeper服务与kafka集群的联系 这里首先说一下broker的概念:Kafka 集群包含一个或多个服务器,这种服务器被称为 broker,每个broker服务器都要连接到zk服务。一个典型的kafka集群中包...

1 zookeeper如何实现高可用 1 zookeeper 多台构成集群实现高可用,有三种角色群首(leader),追随者(follower),观察者(observer)。Leader作为整个ZooKeeper集群的主节点,负责响应所有对ZooKeeper状态变更的请求。它会将每个状态更新请求进行排序和编号,以便保证整个集群内部消息处理的FIFOFollower的逻辑就比较简单了。除了响应本服务器上的读请求外,follower还要处理leader的提议,并在leader提交该提议时在本地也进行...

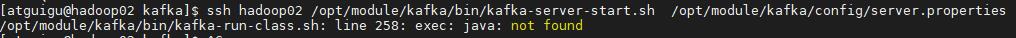

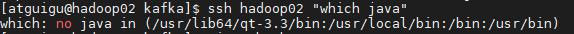

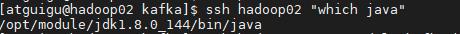

Kafka 0.9版本对java client的api做出了较大调整,本文主要总结了Kafka 0.9在集群搭建、高可用性、新API方面的相关过程和细节,以及本人在安装调试过程中踩出的各种坑。 关于Kafka的结构、功能、特点、适用场景等,网上到处都是,我就不再赘述了,直接进入正文 Kafka 0.9集群安装配置 操作系统:CentOS 6.5 1. 安装Java环境 Zookeeper和Kafka的运行都需要Java环境,所以先安装JRE,Kafka默认使用G1垃圾回收器,如果不更改垃圾回...

isr_change_notification目录admin目录topic 配置/config/topics/[topic_name]consumer offset/consumers/[groupId]/offsetsconsumer owner/consumers/[groupId]/owners/consumer注册信息/consumers/[groupId]/ids/[consumerIdStringcontroller注册信息/controller – controller epoch/controller_epoch -> int (epoch) broker注册信息/brokers/ids/[0...N] partition状态信息/brokers/topics/[topic]/partitions/[0...N]...

参考链接:apache kafka系列之在zookeeper中存储结构 http://blog.csdn.net/lizhitao/article/details/23744675 1.topic注册信息/brokers/topics/[topic] :存储某个topic的partitions所有分配信息Schema:

{ "version": "版本编号目前固定为数字1", "partitions": { "partitionId编号": [ 同步副本组brokerId列表 ], "partitionId编号": [ 同步副本组brokerId列表 ], ...

在做kafka测试的时候,使用命令bin/kafka-console-consumer.sh --zookeeper 192.168.0.140:2181,192.168.0.141:2181 --topic test --from-beginning启动消费者,发现一只报错consumer zookeeper is not a recognized option,搜索了半天,一只没有解决,最后,换了一个低版本的kakfa,发现在启动的时候说使用 --zookeeper是一个过时的方法,此时,才知道原来在最新的版本中,这种启动方式已经被删除了,最后附上0.90版本之后启动消...

1.topic注册信息/brokers/topics/[topic] :存储某个topic的partitions所有分配信息Schema:

{ "version": "版本编号目前固定为数字1", "partitions": { "partitionId编号": [ 同步副本组brokerId列表 ], "partitionId编号": [ 同步副本组brokerId列表 ], ....... }}

Example:{"version": 1,"partitions": {"0": [1, 2],"1": [2, 1],"2": [1, 2],}}说明:紫红色...

从零基础到高级,一对一培训![技术QQ:2937765541]

-------------------------------------------------------------------------------------------------------------------------------------------

课程体系:获取视频资料和培训解答技术支持地址

课程展示(大数据技术很广,一直在线为你培训解答!):

获取视频资料和培训解答技术支持地址 大数据架构开发 挖掘分析 Hadoop HBase Hive Storm Spark Sqoop Flume ZooKeep...

从零基础到高级,一对一技术培训!全程技术指导![技术QQ:2937765541]

https://item.taobao.com/item.htm?id=535950178794

-------------------------------------------------------------------------------------

Java互联网架构师培训!https://item.taobao.com/item.htm?id=536055176638大数据架构开发 挖掘分析 Hadoop HBase Hive Storm Spark Sqoop Flume ZooKeeper Kafka Redis MongoDB 机器学习 云计算 视频教程 Java互...

对于mysql,redis,Kafka,zookeeper磁盘缓存技术使用分析

大部分组件是基于磁盘存储的,但由于CPU速度和磁盘速度之间的鸿沟,都会使用缓存技术来提高性能,缓存简单来说就是一块内存区域,首先将从磁盘读到的数据放在缓存中,之后查询或修改时直接操作缓存,对于缓存中的数据则以一定的频率刷新到磁盘上,怎样缓存,缓存多少,何时刷新,这些影响着整个组件的性能。在看过一些关于mysql等组件的架构原理后,会发现不论是基于磁盘的...

24道常见Elasticsearch 面试题(截取部分)1、客户端在和集群连接时,如何选择特定的节点执行请求的?

2、详细描述一下 Elasticsearch 索引文档的过程。

3、详细描述一下 Elasticsearch 更新和删除文档的过程。

4、详细描述一下 Elasticsearch 搜索的过程。

5、在 Elasticsearch 中,是怎么根据一个词找到对应的倒排索引的?

6、Elasticsearch 在部署时,对 Linux 的设置有哪些优化方法?

7、对于 GC 方面,在使用 Elasticsearch 时...

一.平台环境介绍:1.系统信息:项目信息系统版本:Ubuntu14.04.2 LTS \n \l用户:*****密码:******Java环境:openjdk-7-jre语言:en_US.UTF-8,en_US:en磁盘:每台vda为系统盘(50G),vdb为数据盘(200G)挂载于/storage目录hcloud15最为DB,第二块磁盘为2000G主机范围:192.168.21.7~192.168.21.15,192.168.21.17,192.168.21.18(11台)主机名:以IP地址为准,依次为hcloud07~hcloud182.服务组件分布:服务名称分布主机Zookeeperhcl...

目前,Apache Kafka 使用 Apache ZooKeeper 来存储它的元数据,比如分区的位置和主题的配置等数据就是存储在 ZooKeeper 集群中。在 2019 年社区提出了一个计划[1],以打破这种依赖关系,并将元数据管理引入 Kafka 本身。所以 Apache Kafka 为什么要移除 Zookeeper 的依赖?Zookeeper 有什么问题?实际上,问题不在于 ZooKeeper 本身,而在于外部元数据管理的概念。拥有两个系统会导致大量的重复。毕竟,Kafka 是一个分布式的发布-订...

152.kafka 可以脱离 zookeeper 单独使用吗?为什么?

kafka不能脱离zookeeper单独使用,因为kafka使用zookeeper管理和协调kafka的节点服务器

153.kafka 有几种数据保留的策略?

kafka有两种数据保存策略:按照过期时间保留和按照存储的消息大小保留

154.kafka 同时设置了 7 天和 10G 清除数据,到第五天的时候消息达到了 10G,这个时候 kafka 将如何处理?

kafka会执行数据清除工作,时间和大小不论满足哪个条件,都会清空数据

155...

Kafka初识

1、Kafka使用背景在我们大量使用分布式数据库、分布式计算集群的时候,是否会遇到这样的一些问题:我们想分析下用户行为(pageviews),以便我们设计出更好的广告位

我想对用户的搜索关键词进行统计,分析出当前的流行趋势

有些数据,存储数据库浪费,直接存储硬盘效率又低 这些场景都有一个共同点:

数据是由上游模块产生,上游模块,使用上游模块的数据计算、统计、分析,这个时候就可以使用消息系统,尤其是分布式消息...