import tensorflow as tfwith tf.variable_scope("foo"):v = tf.get_variable("v", [1], initializer=tf.constant_initializer(1.0))#with tf.variable_scope("foo"):# v = tf.get_variable("v", [1])

with tf.variable_scope("foo", reuse=True):v1 = tf.get_variable("v", [1])

print(v == v1)#with tf.variable_scope("bar", reuse=True):# v = tf.get_variable("v", [1])with tf.variable_scope("root"):print(tf.get_vari...

前面已经使用TensorFlow2的原生代码搭建神经网络,接下来将使用keras搭建神经网络,并改写鸢尾花分类问题的代码,将原本100多行的代码用不到20行代码实现。用TensorFlow API:tf.keras搭建网络使用Sequential六步法:import,相关模块train, test,指定训练集的输入特征,和训练集的标签model = tf.keras.models.Sequential,搭建网络结构,(顺序神经网络)model.compile,配置训练方法model.fit,执行训练model.summary,打印出网...

数据处理样本数据描述样本数据集是double类型的178 * 14矩阵,第一列表示酒所属类别,后面13列分别表示当前样本的13个属性:1) Alcohol2) Malic acid3) Ash4) Alcalinity of ash 5) Magnesium6) Total phenols7) Flavanoids8) Nonflavanoid phenols9) Proanthocyanins10) Color intensity11) Hue12) OD280/OD315 of diluted wines13) Proline数据预处理将文件内容读入矩阵,由于标签有三类,分别是1、2、3,于是进行二进制化。由于...

import tensorflow as tf

from tensorflow.examples.tutorials.mnist import input_data

import os

os.environ["CUDA_DEVICE_ORDER"] = "0,1"mnist = input_data.read_data_sets("MNIST_data",one_hot=True)def compute_accuracy(v_xs,v_ys):global predictiony_pre = sess.run(prediction,feed_dict ={xs:v_xs,keep_prob:1})correct_predicton = tf.equal(tf.argmax(y_pre,1),tf.argmax(v_ys,1))accuracy = tf.reduce_mean(tf.cas...

一、卷积神经网络(Convolutional Neural Networks, CNN)是一类包含卷积计算且具有深度结构的前馈神经网络(Feedforward Neural Networks),是深度学习(deep learning)的代表算法之一 [1-2] 。卷积神经网络具有表征学习(representation learning)能力,能够按其阶层结构对输入信息进行平移不变分类(shift-invariant classification),因此也被称为“平移不变人工神经网络(Shift-Invariant Artificial Neural Networks, S...

深度神经网络可解释性方法汇总,附 Tensorflow 代码实现 知识库 ? 小白学CV ? 于 10个月前 ? 2076 阅读 理解神经网络:人们一直觉得深度学习可解释性较弱。然而,理解神经网络的研究一直也没有停止过,本文就来介绍几种神经网络的可解释性方法,并配有能够在Jupyter下运行的代码链接。 1.Activation Maximization通过激活最化来解释深度神经网络的方法一共有两种,具体如下:1.1 Activation Maximization (AM)相关代码如下:https:...

本实验通过建立一个含有两个隐含层的BP神经网络,拟合具有二次函数非线性关系的方程,并通过可视化展现学习到的拟合曲线,同时随机给定输入值,输出预测值,最后给出一些关键的提示。源代码如下:# -*- coding: utf-8 -*-import tensorflow as tf

import numpy as np

import matplotlib.pyplot as pltplotdata = { "batchsize":[], "loss":[] }

def moving_average(a, w=11):if len(a) < w: return a[:] return [val if idx < w...

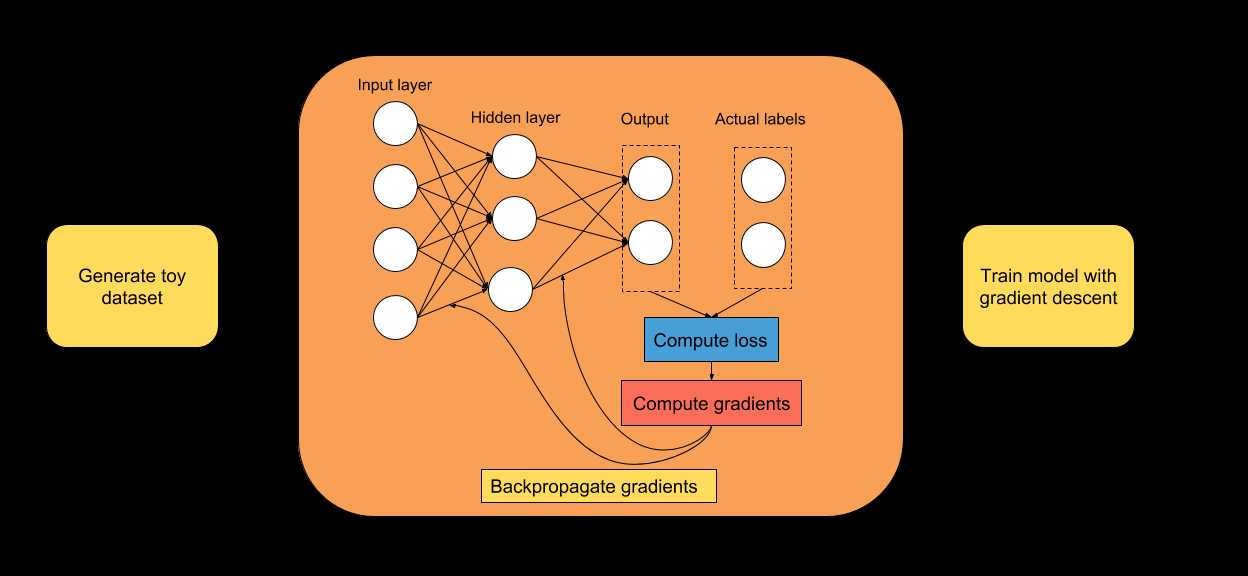

典型神经网络模型:(图片来源:https://github.com/madalinabuzau/tensorflow-eager-tutorials) 保持更新,更多内容请关注 cnblogs.com/xuyaowen;原文:https://www.cnblogs.com/xuyaowen/p/tensorflow-nn-Eager.html

# 创建神经网络, 使用tensorboard 展示graph/histogram/scalarimport tensorflow as tf

import numpy as np

import matplotlib.pyplot as plt # 若没有 pip install matplotlib# 定义一个神经层def add_layer(inputs, in_size, out_size,n_layer, activation_function=None):#add one more layer and return the output of this layerlayer_name="layer%s"%n_layerwith tf.name_scope(layer_name):with tf.name_scope(‘Weights‘...

使用captcha.image.Image 生成随机验证码,随机生成的验证码为0到9的数字,验证码有4位数字组成,这是一个自己生成验证码,自己不断训练的模型使用三层卷积层,三层池化层,二层全连接层来进行组合第一步:定义生成随机验证码图片number = [‘0‘,‘1‘,‘2‘,‘3‘,‘4‘,‘5‘,‘6‘,‘7‘,‘8‘,‘9‘]

# alphabet = [‘a‘,‘b‘,‘c‘,‘d‘,‘e‘,‘f‘,‘g‘,‘h‘,‘i‘,‘j‘,‘k‘,‘l‘,‘m‘,‘n‘,‘o‘,‘p‘,‘q‘,‘...

import tensorflow as tf# 输入数据from tensorflow.examples.tutorials.mnist import input_datamnist = input_data.read_data_sets("E:\\MNIST_data", one_hot=True)# 定义网络的超参数

learning_rate = 0.001

training_iters = 200000

batch_size = 128

display_step = 5# 定义网络的参数

# 输入的维度 (img shape: 28*28)

n_input = 784

# 标记的维度 (0-9 digits)

n_classes = 10

# Dropout的概率,输出的可能性

dropout = ...

使用人工神经网络完成手写数字识别任务。具体要求如下:

(1)batch_size和step_num自定义,把loss值打印出来。

(2)神经网络的层数、节点数目、激活函数自定义。(记录心得)

(3)使用tensorboard把计算图显示出来。一、初始数据如下:batch_size=64lr = 0.01 #学习率step_num = 6000 #计算6000次计算的神经元层数是3层使用的是随机梯度下降算法 tf.train.GradientDescentOptimizer()计算出来的准确度为:0.717 二、参数调优过程...

加载cifar10图片集并准备将图片进行灰度化

from keras.datasets import cifar10def rgb2gray(rgb):#把彩色图转化为灰度图,如果当前像素点为[r,g,b],那么对应的灰度点为0.299*r+0.587*g+0.114*breturn np.dot(rgb[...,:3], [0.299, 0.587, 0.114])(x_train, _),(x_test, _) = cifar10.load_data()img_rows = x_train.shape[1]

img_cols = x_train.shape[2]

channels = x_train.shape[3]#将100张彩色原图集合在一起显示

imgs = x_t...

from keras.layers import SimpleRNN

model = Sequential()

model.add(embedding_layer)

model.add(SimpleRNN(32))

#当结果是输出多个分类的概率时,用softmax激活函数,它将为30个分类提供不同的可能性概率值

model.add(layers.Dense(len(int_category), activation=softmax))#对于输出多个分类结果,最好的损失函数是categorical_crossentropy

model.compile(optimizer=rmsprop, loss=categorical_crossentropy, metrics=[accurac...

from keras.layers import LSTM

model = Sequential()

model.add(embedding_layer)

model.add(LSTM(32))

#当结果是输出多个分类的概率时,用softmax激活函数,它将为30个分类提供不同的可能性概率值

model.add(layers.Dense(len(int_category), activation=softmax))#对于输出多个分类结果,最好的损失函数是categorical_crossentropy

model.compile(optimizer=rmsprop, loss=categorical_crossentropy, metrics=[accuracy])

histor...