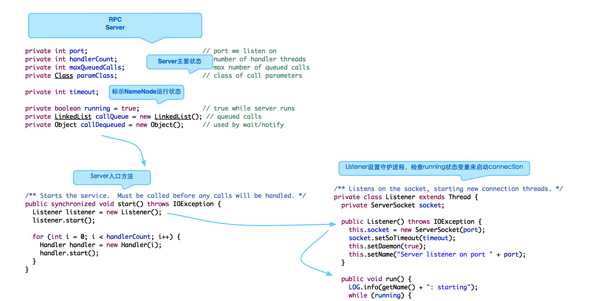

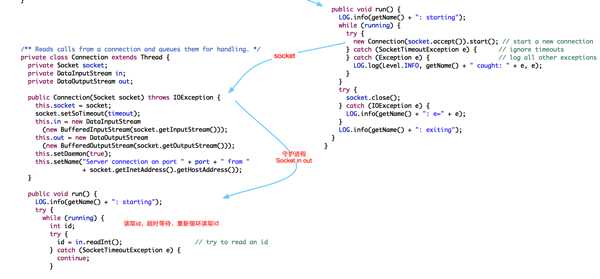

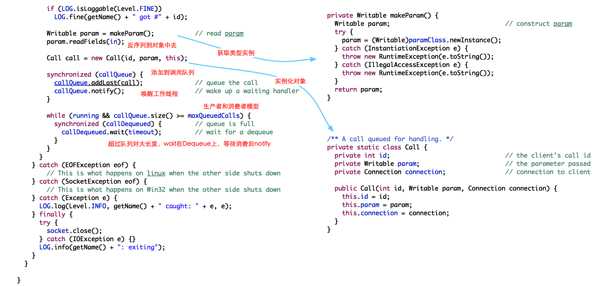

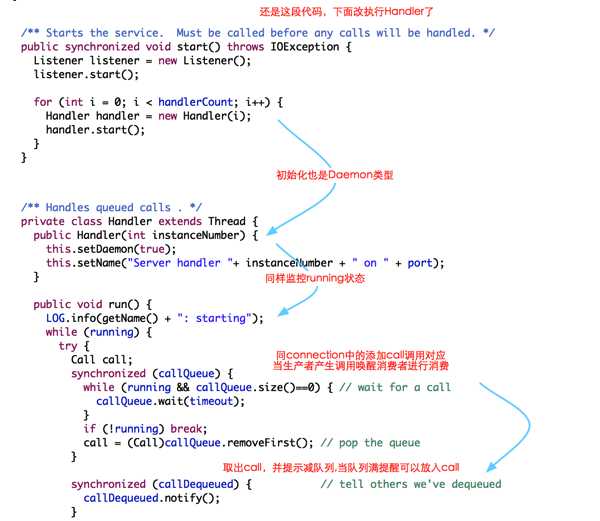

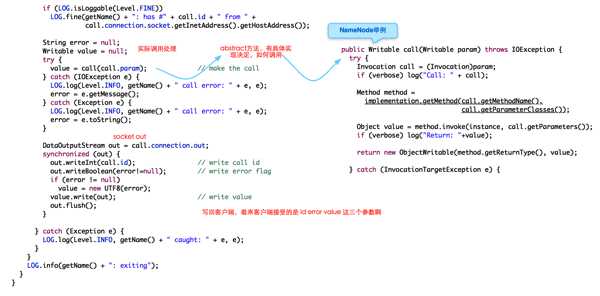

好了,让我们先来看看RPC的基础Server类的具体实现,很多设计思想和实践方式值的学习。重点不是看过源码,而是从源码中学习到了什么。尤其是其中,wait和notify的使用很好的学习范例,当然还有反射...Server start()方法是入口类,基本线程都是Daemon方式让我们来看看run里面执行了什么,主要是建立socket读取客户度请求。并将客户度请求并封装为call放入队列,提醒消费者使用。下面就是Handler,主要是处理,connection接受的对象...

读取命名空间镜像和编辑日志数据1.读取命名空间镜像类FSImage是 命名空间镜像的java实现,在源码中,英文注释为,/*** FSImage handles checkpointing and logging of the namespace edits.**/FSImage.loadFSImage(FSNamesystem, StartupOption, MetaRecoveryContext) 读取命名空间镜像。 1privateboolean loadFSImage(FSNamesystem target, StartupOption startOpt,2 MetaRecoveryContext recove...

引言 引用《Hadoop权威指南》原文如下: Hadoop works better with a small number of large files than a large number of small files. One reason for this is that FileInputFormat generates splits in such a way that each split is all or part of a single file. If the file is very small (“small” means significantly smaller than an HDFS block) and there are a lot of them, each map task will process very l...

1、 简介

Hadoop是一个由Apache基金会所开发的分布式系统基础架构。Hadoop起源于谷歌发布的三篇论文:GFS、MapReduce、BigTable。其中GFS是谷歌的分布式文件存储系统,MapReduce是基于这个分布式文件存储系统的一个计算框架,BigTable是一个分布式的数据库。hadoop实现了论文GFS和MapReduce中的内容,Hbase的实现了参考了论文BigTable。

2、 hadoop架构

hadoop主要有三个组件:HDFS、YARN和MapReduce。其中YARN是hadoop2.x版本推出...

一. 前言

处理来自ApplicationMaster的请求, 主要包括注册和心跳两种请求, 其中, 注册是ApplicationMaster启动时发生的行为, 注册请求包中 包含ApplicationMaster启动节点; 对外RPC端口号和tracking URL等信息; 而心跳则是周期性行为, 汇报信息包含所需资源描述、 待释放的Container列表、 黑名单列表等, 而AMS则为之返回新分配的Container、 失败的Container、 待抢占的Container列表等信息。二. 接口协议

用于对所有提交...

Hadoop进入安全模式有三个条件具体源码如下private boolean needEnter() {// TODO-ZH DataNode汇报block状态为complete状态数量return (threshold != 0 && blockSafe < blockThreshold) ||// TODO-ZH 默认存活DataNode节点小于 datanodeThreshold(默认为0)(datanodeThreshold != 0 && getNumLiveDataNodes() < datanodeThreshold) ||// TODO-ZH 元数据存储磁盘空间是不充足(!nameNodeHasResourcesAvailable());}条件一:threshol...

一 前言在mapreduce中,对于一个job,它的提交流程,我们有必要去研究一下,当然,在这里只是研究它的一个大体流程,并不会精确到每一句代码 (adsbygoogle = window.adsbygoogle || []).push({});标签:,,,,,,,,

来源: https://blog.csdn.net/xiaoxi_hahaha/article/details/110382721

上一篇 讲解了nameNode启动的时候,NameNodeHttpServer的启动流程,其实简单来说就是基于hadoop自己实现的HttpServer2服务绑定一个InetSokcetAddress地址,也就是端口号,端口号哪来的?默认配置文件获取呗,最后在将HttpServer2中绑定一些servlet来处理url请求就完成了我们50070端口的请求处理。

那么本篇分析nameNode进程第二个比较核心的,应该说是最核心的组件 FSNamesystem,为什么说是最核心组件呢,因为元数据管理和block的...

二话不说,先上代码与执行。

package com.yarn.wc;

import java.io.IOException;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;

publ...