吴恩达深度学习课程第一课 — 神经网络与深度学习 — 第四周练习

内容导读

互联网集市收集整理的这篇技术教程文章主要介绍了吴恩达深度学习课程第一课 — 神经网络与深度学习 — 第四周练习,小编现在分享给大家,供广大互联网技能从业者学习和参考。文章包含2255字,纯文字阅读大概需要4分钟。

内容图文

第四周 - 深度神经网络的核心概念

第 31 题

在我们的前向传播和后向传播实现中使用的“缓存”是什么?

A.它用于在训练期间缓存成本函数的中间值。

B.我们用它将在正向传播过程中计算的变量传递到相应的反向传播步骤。它包含了反向传播计算导数的有用值。

C.它用于跟踪我们正在搜索的超参数,以加快计算速度。

D.我们用它将反向传播过程中计算的变量传递到相应的正向传播步骤。它包含用于计算正向传播的激活的有用值。

第 32 题

以下哪些是“超参数”?(选出所有正确项)

A.隐藏层规模\(n^{[l]}\)

B.神经网络的层数\(L\)

C.激活向量\(a^{[l]}\)

D.权重矩阵\(W^{[l]}\)

E.学习率\(\alpha\)

F.迭代次数

G.偏置向量\(b^{[l]}\)

第 33 题

下列哪个说法是正确的?

A.神经网络的更深层通常比前面的层计算更复杂的特征

B.神经网络的前面的层通常比更深层计算更复杂的特性

第 34 题

向量化允许您在L层神经网络中计算前向传播时,不需要在层l = 1, 2, …, L间显式的使用for循环(或任何其他显式迭代循环)

A.对

B.不对

第 35 题

假设我们将\(n^{[l]}\)的值存储在名为layers的数组中,如下所示:layer_dims = [n_x, 4, 3, 2, 1]。 因此,第1层有4个隐藏单元,第2层有3个隐藏单元,依此类推。 您可以使用哪个for循环初始化模型参数?

A.

for(i in range(1, len(layer_dims/2))):

parameter[‘W’ + str(i)] = np.random.randn(layers[i], layers[i - 1])) * 0.01

parameter[‘b’ + str(i)] = np.random.randn(layers[i], 1) * 0.01

B.

for(i in range(1, len(layer_dims/2))):

parameter[‘W’ + str(i)] = np.random.randn(layers[i], layers[i - 1])) * 0.01

parameter[‘b’ + str(i)] = np.random.randn(layers[i-1], 1) * 0.01

C.

for(i in range(1, len(layer_dims))):

parameter[‘W’ + str(i)] = np.random.randn(layers[i-1], layers[i])) * 0.01

parameter[‘b’ + str(i)] = np.random.randn(layers[i], 1) * 0.01

D.

for(i in range(1, len(layer_dims))):

parameter[‘W’ + str(i)] = np.random.randn(layers[i], layers[i-1])) * 0.01

parameter[‘b’ + str(i)] = np.random.randn(layers[i], 1) * 0.01

第 36 题

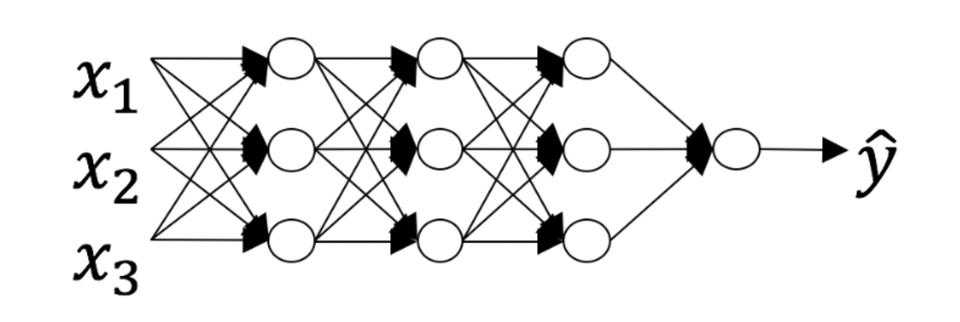

考虑以下神经网络:

该神经网络有几层?

A.层数\(L\)是4,隐藏层数是3

B.层数\(L\)是3,隐藏层数是3

C.层数\(L\)是4,隐藏层数是4

D.层数\(L\)是5,隐藏层数是4

第 37 题

在前向传播期间,在层\(l\)的前向传播函数中,您需要知道层\(l\)中的激活函数(Sigmoid,tanh,ReLU等)是什么。在反向传播期间,相应的反向传播函数也需要知道第\(l\)层的激活函数是什么,因为梯度是根据它来计算的

A.对

B.不对

第 38 题

有一些函数具有以下特性:

(i) 当使用浅网络计算时,需要一个大网络(我们通过网络中的逻辑门数量来度量大小),但是(ii)当使用深网络来计算时,我们只需要一个指数级小的网络

A.对

B.不对

第 39 题

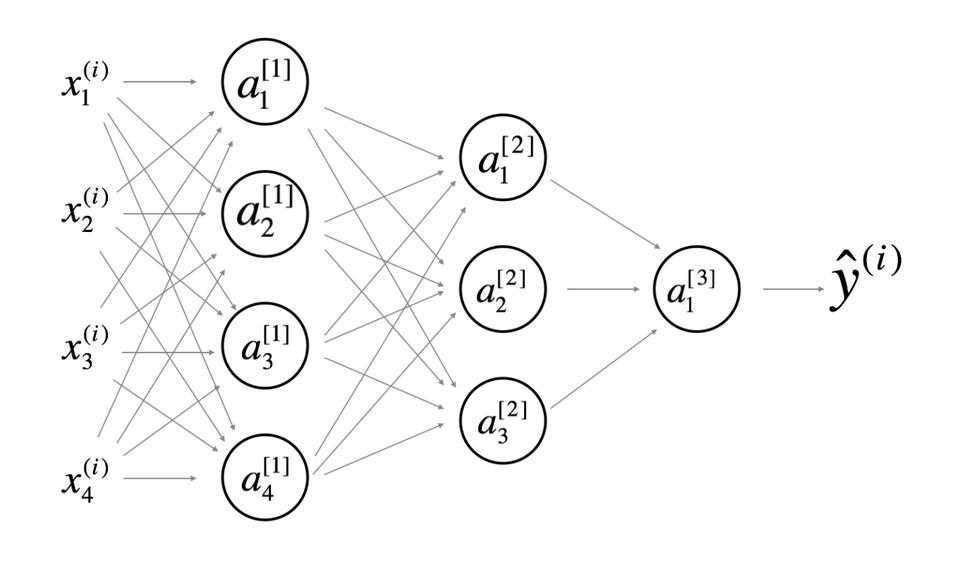

在以下2层隐藏层的神经网络中,以下哪句话是正确的?

A.\(W^{[1]}\) 的形状是 (4, 4)

B.\(b^{[1]}\) 的形状是 (4, 1)

C.\(W^{[2]}\) 的形状是 (3, 4)

D.\(b^{[2]}\) 的形状是 (3, 1)

E.\(b^{[3]}\) 的形状是 (1, 1)

F.\(W^{[3]}\) 的形状是 (1, 3)

第 40 题

前面的问题使用了一个特定的网络,一般情况下,层\(l\)的权重矩阵\(W^{[l]}\)的维数是多少?

A.\(W^{[l]}\) 的形状是 \((n^{[l]},n^{[l-1]})\)

B.\(W^{[l]}\) 的形状是 \((n^{[l-1]},n^{[l]})\)

C.\(W^{[l]}\) 的形状是 \((n^{[l+1]},n^{[l]})\)

D.\(W^{[l]}\) 的形状是 \((n^{[l]},n^{[l+1]})\)

31-40题 答案

31.B 32.ABEF 33.A 34.B 35.D 36.A 37.A 38.A 39.ABCDEF 40.A

原文:https://www.cnblogs.com/YukiNote/p/12261987.html

内容总结

以上是互联网集市为您收集整理的吴恩达深度学习课程第一课 — 神经网络与深度学习 — 第四周练习全部内容,希望文章能够帮你解决吴恩达深度学习课程第一课 — 神经网络与深度学习 — 第四周练习所遇到的程序开发问题。 如果觉得互联网集市技术教程内容还不错,欢迎将互联网集市网站推荐给程序员好友。

内容备注

版权声明:本文内容由互联网用户自发贡献,该文观点与技术仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容, 请发送邮件至 gblab@vip.qq.com 举报,一经查实,本站将立刻删除。

内容手机端

扫描二维码推送至手机访问。