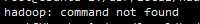

问题:昨天在安装完hadoop伪分布式之后,执行hadoop下的子项目--文字计数功能时出现该错误,然后今天执行 hadoop fs -ls命令时系统给出同样的错误提醒,经过查找资料,初步认为是hadoop的path未加到系统配置文件中。cd /etc

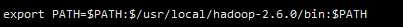

vi profile在profile文件中插入export PATH=$PATH:$/usr/local/hadoop-2.6.0/bin:$PATH 如图: 再执行:source /etc/profile将文件进行重载然后发现Hadoop下的子项目可以顺利执行,但是hdfs的xshell命令还是...

1.Hadoop集群可以运行的3个模式? 单机(本地)模式伪分布式模式全分布式模式 2. 单机(本地)模式中的注意点?在单机模式(standalone)中不会存在守护进程,所有东西都运行在一个JVM上。这里同样没有DFS,使用的是本地文件系统。单机模式适用于开发过程中运行MapReduce程序,这也是最少使用的一个模式。3. 伪分布模式中的注意点?伪分布式(Pseudo)适用于开发和测试环境,在这个模式中,所有守护进程都在同一台机器上运行。4....

一.安装 protobufubuntu 系统1 在 /etc/ld.so.conf.d/目录下创建文件 libprotobuf.conf 写入内容 /usr/local/lib 否则会报 error while loading shared libraries: libprotoc.so.8: cannot open shared obj2../configure make&&make install2.验证安装完成protoc --versionlibprotoc 2.5.0

二.安装 snappy 本地库http://www.filewatcher.com/m/snappy-1.1.1.tar.gz.1777992-0.html下载snappy-1.1.1.tar.gz解压 ./configurema...

转载自:http://my.oschina.net/muou/blog/408543【木偶:Windows下使用Hadoop2.6.0-ecli-p-s-e---p--lugin插件】 对于一些细节地方,我进行了补充。 一.简介Hadoop2.x之后没有Eclipse插件工具,我们就不能在Eclipse上调试代码,我们要把写好的java代码的MapReduce打包成jar然后在Linux上运行,所以这种不方便我们调试代码,所以我们自己编译一个Eclipse插件,方便我们在我们本地上调试,经过hadoop1.x的发展,编译hadoop2.x版本的...

一直在搞spark,也没时间弄hadoop,不过Hadoop基本的编程我觉得我还是要会吧,看到一篇不错的文章,不过应该应用于hadoop2.0以前,因为代码中有 conf.set("mapred.job.tracker", "192.168.1.2:9001");新框架中已改为 Yarn-site.xml 中的 resouceManager 及 nodeManager 具体配置项,新框架中历史 job 的查询已从 Job tracker 剥离,归入单独的mapreduce.jobtracker.jobhistory 相关配置. mapred.job.tracker的主要用途在于合并map之...

一、准备:1、修改主机名vi /etc/sysconfig/network内容如下:NETWORKING=yesHOSTNAME=myHadoop2、修改主机名和IP的映射关系vi /etc/hosts192.168.127.150myHadoop3、关闭防火墙3.1、查看防火墙状态service iptables status3.2、关闭防火墙service iptables stop3.3、查看防火墙开机启动状态chkconfig iptables --list3.4、关闭防火墙开机启动chkconfig iptables off4、重启Linux:reboot/shutdown -r now二、安装JDK:1、解压:ta...

MapReduce由于最耗时的是落盘与通信,所以采用了自定的Writeable的序列化反序列化(在结构化对象与二进制流之间的转换以便于节点通信:压缩过,使得节点之间带宽占用较少,可以快速读写),在Mapper Reducer里头常用的比如LongWriteable Text等等。我们根据不同的需求,对其进行一个复杂的定制,主要通过继承Writeable接口来实现。 源码如下首先看下Writeable接口package org.apache.hadoop.io;

publicinterface Writable { voi...

转载请注明出处:http://blog.csdn.net/l1028386804/article/details/460579091、Mapper类的实现 /*** KEYIN 即k1 表示行的偏移量* VALUEIN 即v1 表示行文本内容* KEYOUT 即k2 表示行中出现的单词* VALUEOUT 即v2 表示行中出现的单词的次数,固定值1*/static class MyMapper extends Mapper<LongWritable, Text, Text, LongWritable>{protected void map(LongWritable k1, Text v1, Context context) throws java.io.IOExceptio...

关于hadoop的HA配置以及wordcount测试一,简单环境配置1,查看centos版本位数:$>getconf LONG_BIT,2,桌面模式和文本模式之间进行切换:1),在终端命令行进行设置时只能暂时改变模式, $>init 3 表示切换到文本模式 $>init 5 表示切换到桌面模式2),永久改变模式需要修改配置文件,进入到etc目录下 $>sudo nano inittab 修改该文件最后一行 若需要文本模式则改为 id:3:initdefault 若需要桌面模式...

CDH5包下载:http://archive.cloudera.com/cdh5/主机规划:IPHost部署模块进程192.168.107.82Hadoop-NN-01NameNodeResourceManagerNameNodeDFSZKFailoverControllerResourceManager192.168.107.83Hadoop-DN-01Zookeeper-01DataNodeNodeManagerZookeeperDataNodeNodeManagerJournalNodeQuorumPeerMain192.168.107.84Hadoop-DN-02Zookeeper-02DataNodeNodeManagerZookeeperDataNodeNodeManagerJournalNodeQuorumPeerMain各个进程解释...

进程------------------ [hdfs]start-dfs.sh NameNode NN DataNode DN SecondaryNamenode 2NN [yarn]start-yarn.sh ResourceMananger RM NodeManager NM脚本分析------------------- sbin/start-all.sh -------------- libexec/hadoop-config.sh start-dfs.sh start-yarn.sh sbin/start-dfs.sh -------------- libexec/hadoop-config.sh sbin/hadoop-daemons.sh --config .. --hostname .. sta...

一、hadoop是什么? (1)Hadoop是一个开源的框架,可编写和运行分布式应用处理大规模数据,是专为离线和大规模数据分析而设计的,并不适合那种对几个记录随机读写的在线事务处理模式。Hadoop=HDFS(文件系统,数据存储技术相关)+ Mapreduce(数据处理),Hadoop的数据来源可以是任何形式,在处理半结构化和非结构化数据上与关系型数据库相比有更好的性能,具有更灵活的处理能力,不管任何数据形式最终会转化为key/value,key/va...

一、背景在目前规模比较大的互联网公司中,总数据量能达到10PB甚至几十PB数据量的公司,我认为中国已经有超过了20家了。而在这些公司中,也有很多家公司的 日数据增长达到100TB+ 了。所以我们每天都要观察集群的数据增长,观察是否有哪一天、哪个路径增长过猛了,是否增长了很多垃圾数据;继续深挖下去,看看是不是可以删掉无用的数据。此外我们还要做“容量预估“,把未来的数据增长规划出来,主要是依靠数据增长斜率计算出未来一...

Hadoop集群采用SSH免密码登录的形式进行通信,需要事先配置免密码认证。CentOS 7操作系统中默认已经安装了SSH,本书中仅介绍SSH免密码登录配置。在配置SSH时使用Xshell分别登陆6个服务器节点,并进行SSH配置。(1)生成公钥SSH目录在/etc,目录下ssh-keygen -t rsa (提示:生成的认证秘钥并非只有rsa还有一个是dsa),连续敲3个回车就行了,不用输入密码。[hadoop@sys01 ~]$ ssh-keygen -t rsa

Generating public/private rsa key pai...

2.1下载地址1、ApacheHadoop(100%永久开源)下载地址:- http://hadoop.apache.org/releases.html- SVN:http://svn.apache.org/repos/asf/hadoop/common/branches/2、CDH(ClouderaDistributed Hadoop,100%永久开源)下载地址: - http://archive.cloudera.com/cdh4/cdh/4/(是tar.gz文件!) - http://archive.cloudera.com/cdh5/cdh/ (是tar.gz文件!)2.2官方版本说明(1) 官网:http://hadoop.apache.org(2) 下载...

,然后今天执行 hadoop fs -ls命令时系统给出同样的错误提醒,经过查找资料,初步认为是hadoop的path未加到系统配置文件中。

,然后今天执行 hadoop fs -ls命令时系统给出同样的错误提醒,经过查找资料,初步认为是hadoop的path未加到系统配置文件中。