python实现爬取微博热搜存入Mysql

内容导读

互联网集市收集整理的这篇技术教程文章主要介绍了python实现爬取微博热搜存入Mysql,小编现在分享给大家,供广大互联网技能从业者学习和参考。文章包含2685字,纯文字阅读大概需要4分钟。

内容图文

免费学习推荐:python视频教程

python爬取微博热搜存入Mysql

- 最终的效果

- 使用的库

- 目标分析

- 一:得到数据

- 二:链接数据库

- 总代码

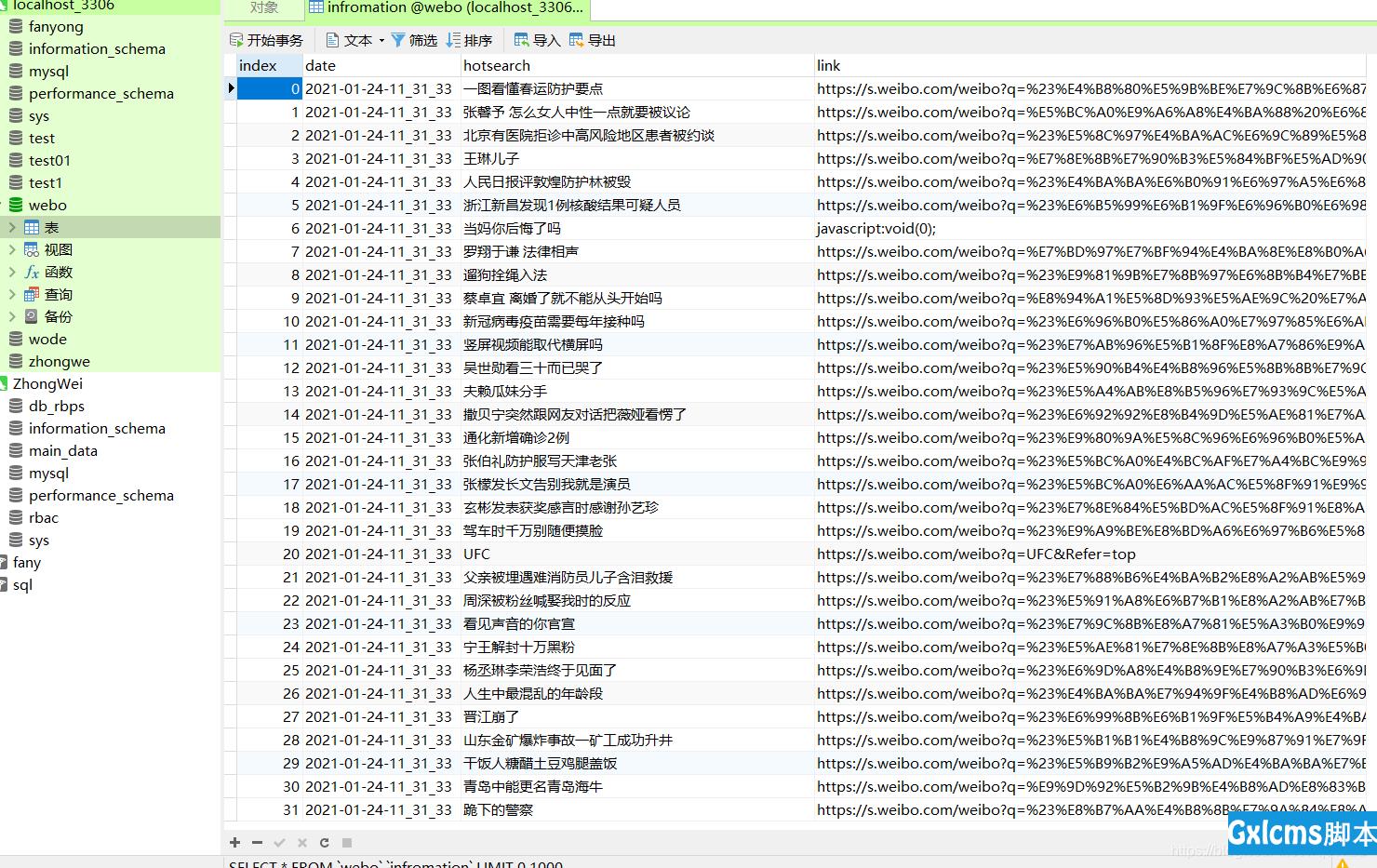

最终的效果

废话不多少,直接上图

这里可以清楚的看到,数据库里包含了日期,内容,和网站link

下面我们来分析怎么实现

使用的库

import requests from selenium.webdriver import Chrome, ChromeOptions import time from sqlalchemy import create_engine import pandas as pd

目标分析

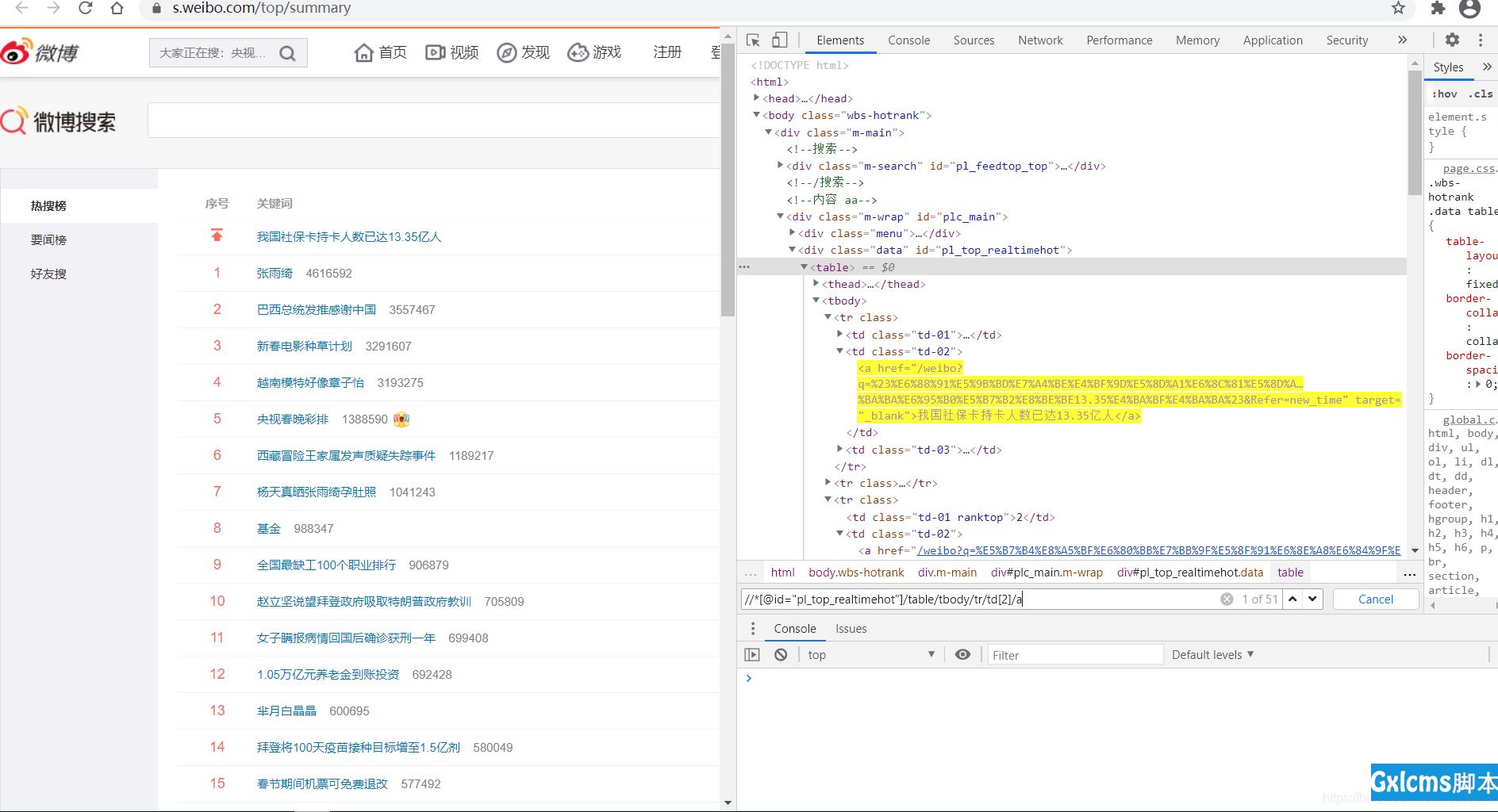

这是微博热搜的link:点我可以到目标网页

首先我们使用selenium对目标网页进行请求

然后我们使用xpath对网页元素进行定位,遍历获得所有数据

然后使用pandas生成一个Dataframe对像,直接存入数据库

一:得到数据

我们看到,使用xpath可以得到51条数据,这就是各热搜,从中我们可以拿到链接和标题内容

all = browser.find_elements_by_xpath('//*[@id="pl_top_realtimehot"]/table/tbody/tr/td[2]/a') #得到所有数据

context = [i.text for i in c] # 得到标题内容

links = [i.get_attribute('href') for i in c] # 得到link然后我们再使用zip函数,将date,context,links合并

zip函数是将几个列表合成一个列表,并且按index对分列表的数据合并成一个元组,这个可以生产pandas对象。

dc = zip(dates, context, links)

pdf = pd.DataFrame(dc, columns=['date', 'hotsearch', 'link'])其中date可以使用time模块获得

二:链接数据库

这个很容易

enging = create_engine("mysql+pymysql://root:123456@localhost:3306/webo?charset=utf8")

pdf.to_sql(name='infromation', con=enging, if_exists="append")总代码

from selenium.webdriver import Chrome, ChromeOptions

import time

from sqlalchemy import create_engine

import pandas as pd

def get_data():

url = r"https://s.weibo.com/top/summary" # 微博的地址

option = ChromeOptions()

option.add_argument('--headless')

option.add_argument("--no-sandbox")

browser = Chrome(options=option)

browser.get(url)

all = browser.find_elements_by_xpath('//*[@id="pl_top_realtimehot"]/table/tbody/tr/td[2]/a')

context = [i.text for i in all]

links = [i.get_attribute('href') for i in all]

date = time.strftime("%Y-%m-%d-%H_%M_%S", time.localtime())

dates = []

for i in range(len(context)):

dates.append(date)

# print(len(dates),len(context),dates,context)

dc = zip(dates, context, links)

pdf = pd.DataFrame(dc, columns=['date', 'hotsearch', 'link'])

# pdf.to_sql(name=in, con=enging, if_exists="append")

return pdf

def w_mysql(pdf):

try:

enging = create_engine("mysql+pymysql://root:123456@localhost:3306/webo?charset=utf8")

pdf.to_sql(name='infromation', con=enging, if_exists="append")

except:

print('出错了')

if __name__ == '__main__':

xx = get_data()

w_mysql(xx)希望能够帮到大家一点,大家一起共同进步,共同成长!

祝大家新年快乐!!!

相关免费学习推荐:python教程(视频)

以上就是python实现爬取微博热搜存入Mysql的详细内容。

本文系统来源:https://www.php.cn/python-tutorials-469424.html内容总结

以上是互联网集市为您收集整理的python实现爬取微博热搜存入Mysql全部内容,希望文章能够帮你解决python实现爬取微博热搜存入Mysql所遇到的程序开发问题。 如果觉得互联网集市技术教程内容还不错,欢迎将互联网集市网站推荐给程序员好友。

内容备注

版权声明:本文内容由互联网用户自发贡献,该文观点与技术仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容, 请发送邮件至 gblab@vip.qq.com 举报,一经查实,本站将立刻删除。

内容手机端

扫描二维码推送至手机访问。