首页 / 爬虫 / python爬虫循环导入MySql数据库

python爬虫循环导入MySql数据库

内容导读

互联网集市收集整理的这篇技术教程文章主要介绍了python爬虫循环导入MySql数据库,小编现在分享给大家,供广大互联网技能从业者学习和参考。文章包含1959字,纯文字阅读大概需要3分钟。

内容图文

操作系统:win10 Python 版本:Python 3.5.2 MySQL:5.5.53

2、用到的模块

没有的话使用pip进行安装:pip install xxx xxx需要安装的模块

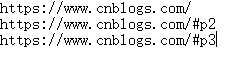

3、分析链接(博客官网:https://www.cnblogs.com/)

这里我们简单分析首页部分

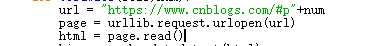

经分析首页的分页系统链接变量是最后一个数字,所以可将访问的链接写成如下模式,这样执行的时候加个循环就能访问需要访问的所有页面内容

4、分析页面内容

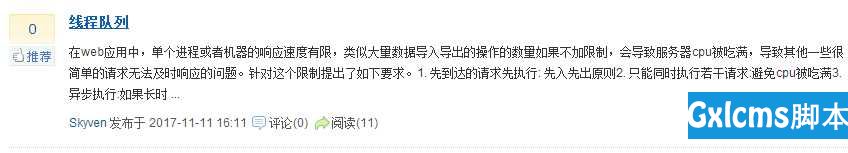

整个页面 咱们需要的信息是博主所发博客的信息,例如:

精确的的说是需要提取博客的标题,简介,发布时间以及博客链接

找到此页面按f12来审查元素

鼠标点下此箭头,然后放到页面内容上,找到咱们所查找的元素,在下面代码部分会出现相应的html:

鼠标右键,选择copy element,可将这块信息复制到文本,找个文本文档保存下来如下部分代码:

这个内容包含一个博客所有信息,接下来用正则提取我们需要的内容即可

5、正则表达式

title= re.compile(‘<a class="titlelnk.*?>(.*?)</a>‘,re.S)

title1= re.findall(title,html)

html是整个网页所有代码文档,这两行代码就将这个网页里面所有博客标题存入title1列表里面

其中<a class="titlelnk.*?>(.*?)</a>是匹配到所有class为titlelnk的a标签,(.*?)是咱们提取的内容

6、链接数据库

db = pymysql.connect("127.0.0.1","root","root","crawler",charset="utf8")#打开数据链接,

pymysql.connect()里面前四个参数我就不多说了,charset="utf8"这个参数可省只是确保编码正确,不然有些环境下无法插入数据

cursor cursor = db.cursor()# 使用 cursor() 方法创建一个游标对象

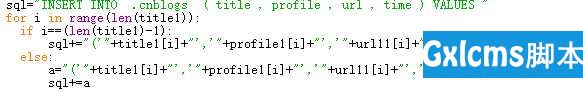

7、MYSQL插入语句

8、整理代码

原理、代码都在这个,想提取所要内容,分析网站即可,当然并不是所有网站都能爬,特殊网站具有反爬措施,需要学习更多知识(访问频率控制,代理IP池等等)

python爬虫循环导入MySql数据库

标签:width 鼠标 正则 没有 logs 页面 python爬虫 ack 简单

本文系统来源:http://www.cnblogs.com/chu03/p/7819464.html

内容总结

以上是互联网集市为您收集整理的python爬虫循环导入MySql数据库全部内容,希望文章能够帮你解决python爬虫循环导入MySql数据库所遇到的程序开发问题。 如果觉得互联网集市技术教程内容还不错,欢迎将互联网集市网站推荐给程序员好友。

内容备注

版权声明:本文内容由互联网用户自发贡献,该文观点与技术仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容, 请发送邮件至 gblab@vip.qq.com 举报,一经查实,本站将立刻删除。

内容手机端

扫描二维码推送至手机访问。