使用MapReduce编写的中文分词程序出现了 Exception from container-launch: org.apache.hadoop.util.Shell$ExitCodeException: 这样的问题如图:上网查了好多资料,才明白这是hadoop本身的问题,具体参考:https://issues.apache.org/jira/browse/YARN-1298https://issues.apache.org/jira/browse/MAPREDUCE-5655解决办法是重新编译hadoop具体参考:http://zy19982004.iteye.com/blog/2031172版权声明:本文为博主原创文章,未经博...

原创,转载请注明。谢谢shell启动hadoop集群1:明确启动顺序 1)启动zookeeper集群(分别在centos 4-02,centos6-02,centos7-02) app/zookeeper-3.4.5/bin/zkServer.sh start //启动进程 app/zookeeper-3.4.5/bin/zkServer.sh status //查看状态 2)启动journalnode(分别在centos 4-02,centos6-02,centos7-02) app/hadoop-2.7.2/sbin/hadoop-daemon.sh start journalnode 3)格式化HDFS(centos4-01) hdfs namenode...

deploy.sh脚本

#!/bin/bash#set -xif [ $# -lt 3 ]then echo "Usage: ./deply.sh srcFile(or Dir) descFile(or Dir) MachineTag"echo "Usage: ./deply.sh srcFile(or Dir) descFile(or Dir) MachineTag confFile"exit fi#!/bin/bash#set -xif [ $# -lt 3 ]then echo "Usage: ./deply.sh srcFile(or Dir) descFile(or Dir) MachineTag"echo "Usage: ./deply.sh srcFile(or Dir) descFile(or Dir) MachineTag confFile"exit fisrc=$1...

介绍之前我有篇博文是介绍如何用ansible的playbook来自动化Hadoop Decommission的,本文介绍用shell脚本来实现。脚本都放在跳板机上,远端服务器调用本地脚本完成所有操作,不需要拷贝文件到远端服务器。正文主脚本:decom.sh#!/bin/bash

iplist=/home/hadoop/shell_scripts/iplist

#1. process iplist ,append them into exclude files

# call append.sh

for exclude_host in `cat $iplist` ; do

ssh hadoop@hadoopmaster "b...

spark集群启动的时候可以正常,进入 ./spark-shell 就会出现如下错误配置文件:spark-env.shexport JAVA_HOME=/usr/java/jdk1.7.0_51export SCALA_HOME=/home/hadoop/scala-2.11.6export SPARK_MASTER_IP=master24export SPARK_MASTER_PORT=17077export SPARK_MASTER_WEBUI_PORT=18080export SPARK_WORKER_CORES=1export SPARK_WORKER_MEMORY=30gexport SPARK_WORKER_WEBUI_PORT=18081export SPARK_WORKER_INSTANCES=1INFO SparkEn...

既然HDFS是存取数据的分布式文件系统,那么对HDFS的操作,就是文件系统的基本操作,比如文件的创建、修改、删除、修改权限等,文件夹的创建、删除、重命名等。对HDFS的操作命令类似于Linux的shell对文件的操作,如ls、mkdir、rm等。我们执行以下操作的时候,一定要确定hadoop是正常运行的,使用jps命令确保看到各个hadoop进程。我们执行命令hadoop fs,如图4-1所示。图4-1图中显示了很多命令选项信息。以上截图不全,我在表格4-1中...

环境搭建1、下载Zookeeper安装包

2、解压

3、到Zookeeper解压后的文件夹中,将conf中zoo_sample.cfg复制并重命名为zoo.cfg

4、将zoo.cfg中的autopurge.snapRetainCount=3

autopurge.purgeInterval=1取消注释

以及设置机器的消息传输和选举端口

server.1=node01:2888:3888

server.2=node02:2888:3888

server.3=node03:2888:3888

5、在Zookeeper文件夹中新建zkdatas文件夹,在其中再新建myid

向myid中添加机器id

echo 1 > myid

6、启...

1. 进入hbase命令行 ./hbase shell

2. 显示hbase中的表 list

3. 创建user表,包含info、data两个列族

create ‘user‘, ‘info1‘, ‘data1‘

create ‘user‘, {NAME => ‘info‘, VERSIONS => ‘3‘}4. 向表中插入信息:向user表中插入信息,row key为rk0001,列族info中添加name列标示符,值为zhangsan

put ‘user‘, ‘rk0001‘, ‘info:name‘, ‘zhangsan‘

向user表中插入信息,row key为rk0001,列族info中添加gender列标...

本文发表于本人博客。 我们知道HDFS是Hadoop的分布式文件系统,那既然是文件系统那最起码会有管理文件、文件夹之类的功能吧,这个类似我们的Windows操作系统一样的吧,创建、修改、删除、移动、复制、修改权限等这些操作。 那我们现在来看看hadoop下是怎么操作的。 先输入hadoop fs命令,会看到如下输出:

Usage: java FsShell[-ls <path>][-lsr <path>][-du <path>][-dus <path>][-count[-q] <path>][-mv <src> <dst>][-cp ...

1.基本语法bin/hadoop fs 具体命令 OR bin/hdfs dfs 具体命令dfs是fs的实现类。 2.命令大全 [atguigu@hadoop102 hadoop-2.7.2]$ bin/hadoop fs[-appendToFile <localsrc> ... <dst>][-cat [-ignoreCrc] <src> ...][-checksum <src> ...][-chgrp [-R] GROUP PATH...][-chmod [-R] <MODE[,MODE]... | OCTALMODE> PATH...][-chown [-R] [OWNER][:[GROUP]] PATH...][-copyFromLocal [-f] [-p] <localsrc> ... <dst>][-copyToLocal...

Hadoop读书笔记(一)Hadoop介绍:http://blog.csdn.net/caicongyang/article/details/398986291.shell操作1.1全部的HDFS shell操作命名能够通过hadoop fs获取:[root@hadoop ~]# hadoop fs

Usage: java FsShell

[-ls <path>]

[-lsr <path>]

[-du <path>]

[-dus <path>]

[-count[-q] <path>]

[-mv <src> <dst>]

[-cp <src> <dst>]

[-rm ...

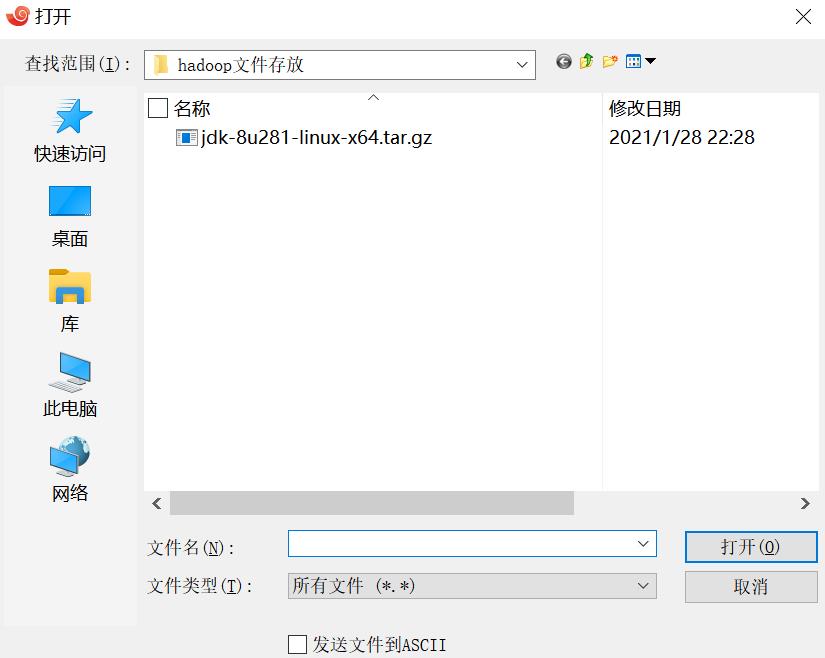

距离上次博客时间已经9天,简单记录下这几天的学习过程2020-02-15 10:38:47一、Linux学习关于Linux命令,我在之前就已经学过一部分了,所以这段时间的linux学习更多的是去学习Linux系统的安装以及相关配置多一些,命令会一些比较常用的就够了,下面记录下安装配置Linux系统时的注意事项。 这里配置的虚拟机的内存为4g使用的 CentOS-6.5-x86_64-minimal.iso 映射文件在进入linux系统中时,需要将虚拟机的主机名修改成自己想要的名...

1、查看帮助hadoop fs -help <cmd>2、上传hadoop fs -put <linux上文件> <hdfs上的路径> 如:hadoop fs -put test.log /3、查看文件内容hadoop fs -cat <hdfs上的路径> 如:hadoop fs -cat /test.log4、查看文件列表hadoop fs -ls /5、下载文件hadoop fs -get <hdfs上的路径> <linux上文件>6、执行jar:如执行hadoop自带的wordcount程序,hadoop jar hadoop-mapreduce-examples-2.4.1.jar wordcount /wordcount/in /wordcount...

目录HDFS常用命令help 查看所有命令查看路径文件创建文件夹创建多级文件夹查看指定目录下和子目录下所有文件上传文件下载文件合并下载复制移动删除查看文件内容显示文件大小testweb界面HDFS常用命令help 查看所有命令[172.23.7.9:hadoop]$ hadoop fs help查看路径文件[172.23.7.9:hadoop]$ hadoop fs -ls /创建文件夹[172.23.7.9:hadoop]$ hadoop fs -mkdir /test创建多级文件夹[172.23.7.9:hadoop]$ hadoop fs -mkdir -p /test/te...

使得任何支持标准IO (stdin, stdout)的可执行程序都能成为hadoop的mapper或者 reducer。例如: 代码如下:hadoop jar hadoop-streaming.jar -input SOME_INPUT_DIR_OR_FILE -output SOME_OUTPUT_DIR -mapper /bin/cat -reducer /usr/bin/wc

在这个例子里,就使用了Unix/Linux自带的cat和wc工具来作为mapper / reducer,是不是很神奇?

如果你习惯了使用一些动态语言,用动态语言来写mapreduce吧,跟之前的编程没有任何不同,hadoop只...