通过condition_variable实现的有最大长度限制的队列:#include <condition_variable>

#include <queue>

#include <chrono>

#include <iostream>/** 有最大队列个数限制*/// 参数T需要能够拷贝,而且拷贝不会存在副作用

template <typename T>

class sync_queue {

public:sync_queue(int queueMaxSize): m_queueMaxSize(queueMaxSize) { }// 处理数据线程template <typename Func>typename std::result_of<Func(T)>::type readQueue(F...

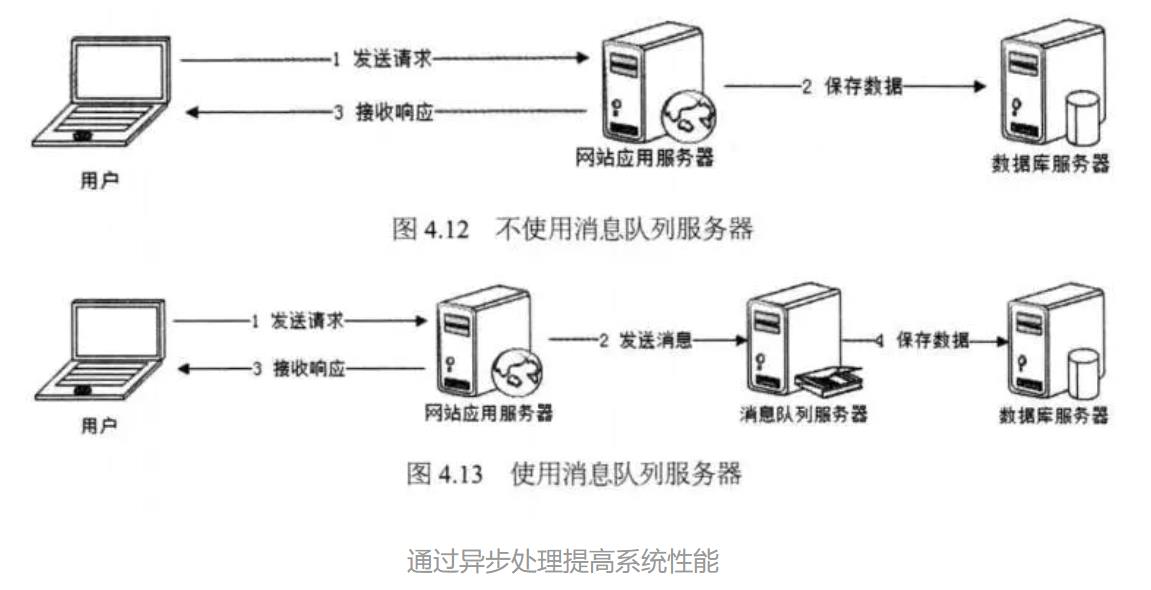

需求背景:有个调用统计日志存储和统计需求,要求存储到mysql中;存储数据高峰能达到日均千万,瓶颈在于直接入库并发太高,可能会把mysql干垮。 问题分析 思考:应用网站架构的衍化过程中,应用最新的框架和工具技术固然是最优选择;但是,如果能在现有的框架的基础上提出简单可依赖的解决方案,未尝不是一种提升自我的尝试。解决: 问题一:要求日志最好入库;但是,直接入库mysql确实扛不住,批量入库没有问题,...

php如何后台监控redis队列是否有值 ,有值执行脚本回复内容:php如何后台监控redis队列是否有值 ,有值执行脚本$idle = 0;

$maxWait = 10;

$interval = 50; //50ms

while(true) {

if($redis->lLen() > 0 ) {$idle = 0;//doing some thingscontinue;

}//这里很重要usleep($interval * ($idle % $maxWait));$idle++;

}crontab

用来生成缓存的队列,每20分钟写入近40W的队列,而缓存生成没那么快,导致队列积累越来越多,内存占用越来越大,各位大神,有啥办法么?回复内容:用来生成缓存的队列,每20分钟写入近40W的队列,而缓存生成没那么快,导致队列积累越来越多,内存占用越来越大,各位大神,有啥办法么?先看看你的架构图批量往redis写http://redis.io/topics/mass-i...一定要往内存里面写吗

import select2 import socket3 import sys4 import queue5 6 7 server = socket.socket()8 server.setblocking(0)9

10 server_addr = (‘localhost‘,10000)

11

12 print(‘starting up on %s port %s‘ % server_addr)

13 server.bind(server_addr)

14

15 server.listen(5)

16

17

18 inputs = [server, ] #自己也要监测呀,因为server本身也是个fd

19 outputs = []

20

21 message_queues = {}

22

23 while True:

24 pr...

gevent import monkey; monkey.patch_all()

import gevent

from urllib.request import urlopendef f(url):print(‘GET: %s‘ % url)resp = urlopen(url)data = resp.read()print(‘%d bytes received from %s.‘ % (len(data), url))gevent.joinall([gevent.spawn(f, ‘https://www.python.org/‘),gevent.spawn(f, ‘https://www.yahoo.com/‘),gevent.spawn(f, ‘https://github.com/‘),

])View Code

通过gevent实现单线程...

李闯切换到了跟海龙搞...李闯搞完了海涛,回来继续跟海龙搞...李闯又回去跟继续跟海涛搞...

同步与异步的性能区别 import geventdef task(pid):"""Some non-deterministic task"""gevent.sleep(0.5)print(‘Task %s done‘ % pid)def synchronous():for i in range(1,10):task(i)def asynchronous():threads = [gevent.spawn(task, i) for i in range(10)]gevent.joinall(threads)print(‘Synchronous:‘)

synchronous()print(‘...

本文系统来源:http://www.cnblogs.com/ygw1010/p/7452140.html

https://www.cnblogs.com/alex3714/articles/5248247.html本节内容

1.Gevent协程

2.Select\Poll\Epoll异步IO与事件驱动

3.Python连接Mysql数据库操作

4.RabbitMQ队列

5.Redis\Memcached缓存

6.Paramiko SSH

7.Twsited网络框架

8-3:协程、异步IO、数据库、rabbitMQ队列、redis缓存标签:tps www href paramik python param sql数据库 mysql uri 本文系统来源:https://www.cnblogs.com/chenhuan123/p/12038657.h...

本文系统来源:http://blog.jobbole.com/99567/

协程,又称微线程,纤程。英文名Coroutine。一句话说明什么是线程:协程是一种用户态的轻量级线程。

协程拥有自己的寄存器上下文和栈。协程调度切换时,将寄存器上下文和栈保存到其他地方,在切回来的时候,恢复先前保存的寄存器上下文和栈。因此:

协程能保留上一次调用时的状态(即所有局部状态的一个特定组合),每次过程重入时,就相当于进入上一次调用的状态,换种说法:进入上一次离开时所处逻辑流的位置。

协程的好处:无...

or

easy_install pika

or

源码

https://pypi.python.org/pypi/pika2.实现最简单的队列通信

a.示意图3.代码:

a.send端#!/usr/bin/env python

import pikaconnection = pika.BlockingConnection(pika.ConnectionParameters(‘localhost‘))

channel = connection.channel()#声明queue

channel.queue_declare(queue=‘hello‘)#n RabbitMQ a message can never be sent directly to the queue, it always needs to go through an exc...

/***************************************************************************

*

* 获取到的调用日志,存入redis的队列中.

* $Id$

*

**************************************************************************/// 获取info

$interface_info = $_GET[‘info‘];// 存入redis队列

$redis = new Redis();

$redis->connect(‘xx‘, 6379);

$redis->auth("password");// 加上时间戳存入队列

$now_time = date("Y-m-d H:i:s");

$r...

问题分析

思考:应用网站架构的衍化过程中,应用最新的框架和工具技术固然是最优选择;但是,如果能在现有的框架的基础上提出简单可依赖的解决方案,未尝不是一种提升自我的尝试。

解决:问题一:要求日志最好入库;但是,直接入库mysql确实扛不住,批量入库没有问题,done。【批量入库和直接入库性能差异参考文章】问题二:批量入库就需要有高并发的消息队列,决定采用redis list 仿真实现,而且方便回滚。问题三:日志量毕竟大,...

Events事件

Queue队列

1、进程与线程的概念

程序并不能单独运行,只有将程序装载到内存中,系统为它分配资源才能运行,而这种执行的程序就称之为进程。程序和进程的区别就在于:程序是指令的集合,它是进程运行的静态描述文本;进程是程序的一次执行活动,属于动态概念。

在多道编程中,我们允许多个程序同时加载到内存中,在操作系统的调度下,可以实现并发地执行。正是这样的设计,大大提高了CPU的利用率。进程的出现让每个用户...