1、向量、矩阵求导当然了,这里补充一下求解过程中的关于向量、矩阵求导的几个公式: 这里其实只需要明白第一个,后边的三个都可以由第一个简单的推导而来。注意这里对列向量AX的每一项的求导写为行,不然就会得到一个超越矩阵,我们不采用这种方式。 原文:http://www.cnblogs.com/futurehau/p/6105236.html

最近在GitHub上学习了有关python实现常见机器学习算法目录一、线性回归 1、代价函数 2、梯度下降算法 3、均值归一化 4、最终运行结果 5、使用scikit-learn库中的线性模型实现二、逻辑回归 1、代价函数 2、梯度 3、正则化 4、S型函数 5、映射为多项式 6、使用的优化方法 7、运行结果 8、使用scikit-learn库中的逻辑回归模型实现逻辑回...

场景用户画像的构造中,想象一个场景:你经过辛辛苦苦抓数据,清洗数据,收集用户行为,目的就是给用户计算兴趣标签。这时候你可能会遇到一个两难的问题:如果给用户计算出兴趣标签的权重了,那应该保留多少标签呢?保留太多的话,每次召回候选集时,计算复杂度可不低,只保留少部分吧,那真是手心手背都是肉,生怕丢弃的标签才是用户的真爱。怎么办?这时候,你需要的一个简单的加权采样算法,每次召回时并不使用全部用户标签,而...

这个主要是线性回归和逻辑回归部分,除了前面关于最小二乘法,后面基本都看不懂,只做了记录。 二维线性模型:普通最小二乘法: 1from__future__import print_function2import numpy as np3import matplotlib.pyplot as plt4from scipy.optimize import minimize5 6# For reproducibility 7 np.random.seed(1000)8# Number of samples 9 nb_samples = 200

1011def loss(v):

12 e = 0.0

13for i in range(nb_samples):

14 ...

#!/usr/bin/python

# -*- coding: utf-8 -*-from numpy import *

import operatordef createDataSet():‘创建数据集‘group=array([[1.0,1.1],[1.0,1.0],[0,0],[0,1.1]])labels=["A","A","B","B"]return group,labelsdef classify(inX,dataSet,labels,k):# 获取维度dataSetSize=dataSet.shape[0] # 训练数据集数量print dataSetSizeprint tile(inX,(dataSetSize,1))diffMat=tile(inX,(dataSetSize,1))-dataSet # 测试样本的各维...

1import pandas as pd2import numpy as np3 4 5def build_data():6""" 7 加载数据8 :return:9"""10# 1、加载数据11 data = pd.read_excel("./电影分类数据.xlsx")

1213return data

141516def distance(v1, v2):

17"""18 计算距离

19 :param v1:点1

20 :param v2: 点2

21 :return: 距离dist

22"""23# 法124# v1 是矩阵 将矩阵转化数组,再进行降为1维25# v1 = v1.A[0]26# print(v1)27# sum_ = 028# for i in ...

import numpy as np

import sklearn.datasets #加载原数据import matplotlib.pyplot as plt

import random#点到各点距离def PointToData(point,dataset):a = np.multiply(dataset - point,dataset - point)# print(‘a‘,a)distence = np.sqrt(a[:,0]+a[:,1])return distence#选择初始的k个中心簇def startpoint(k,dataset):m, n = np.shape(dataset)index1 = random.randint(0,len(dataset) - 1)A = [] # 初始的k个中...

当在现实生活中的遇到问题时,我们总是希望找到最佳的解决方案。制造软件产品也是一样的道理,最优化的程序才是最理想的产品。最优化意味着获得最佳输出。它既是一个数学的重要分支,也在现实生活中有着重要的作用。现代的计算机科学和人工智能科学把最优化作为一个重要的领域来研究。我们也认为人工智能的一些算法,就是模拟了人类寻求实际问题最优解的过程。例如,利用人工智能算法设计软件,配合外部的电子设备例如摄像头识别人...

0.机器学习中分类和预测算法的评估标准 准确率 速度 强壮性 可规模性 可解释性 1、什么是决策树/判定树(decision tree)? 判定树是一个类似于流程图的树结构:其中,每个内部节点表示一个属性上的测试,每个分支代表一个属性的输出,而每个树叶节点代表类或者类分布。树的最顶层是根节点。2、机器学习中分类方法的重要算法是决策树3、构造决策树的基本算法 3.1熵(entropy)概念 信息和抽象,如何度量?19...

上一章学习了非监督学习的聚类,聚类算法可以将不同性质的分类分开。这两天学习了apriori算法进行关联分析,感觉是目前最难理解的一章了,并且书中还有个很坑爹的错误,作者存在很大的疏忽。Apriori算法关联分析:从大规模数据集中寻找物品间的隐含关系被称作关联分析或者关联规则学习。关联分析应用1:我们以前学习的是根据特性进行分类或者回归预测,并没有挖掘特性之间的关系,关联分析可以用于分析数据集中特性之间的关系,可以...

五、SVM求解实例 上面其实已经得出最终的表达式了,下面我们会根据一些具体的点来求解α的值。数据:3个点,其中正例 X1(3,3) ,X2(4,3) ,负例X3(1,1) 如下图所示 我们需要求解下式的极小值 注意约束条件(在这里不要忘记了yi代表的是数据的类别,+1代表正例,-1代表负例) 代入数据,通过化简可以得到如下约束条件的表达式。 将数据代入上式得到 由于α1+α2-α3=0 -> α1+α2=α3: 化简可得: 分别对α1和...

七月算法--12月机器学习在线班-第六次课笔记—梯度下降和拟牛顿七月算法(julyedu.com)12月机器学习在线班学习笔记http://www.julyedu.com 原文:http://www.cnblogs.com/sweet-dew/p/5491249.html

CXCORE库:Mahalanobis距离: K均值: CV库:人脸检测/Haar分类器 ML库:正态朴素贝叶斯分类器: 决策树: Boosting: 随机森林: EM算法: K近邻(KNN): 神经网络/多层感知器: 支持向量机(SVM): 原文:http://www.cnblogs.com/MrLancher/p/6224208.html

SVM上:这个算法应该是机器学习这门课里最重要的部分了。 首先是SVM的思想:找到超平面,将两类中距离最近的点分的越开越好(直至二者相等)。 然后是函数间隔和几何间隔的定义,二者之间的区别。 接着是超平面模型的建立,看看它是如何将问题转化为凸优化问题的。 SVM第一个难点:拉格朗日对偶。由KKT条件可知,起作用的约束都在边界上,这个会用来解释支持向量。 由KKT条件知,在S...

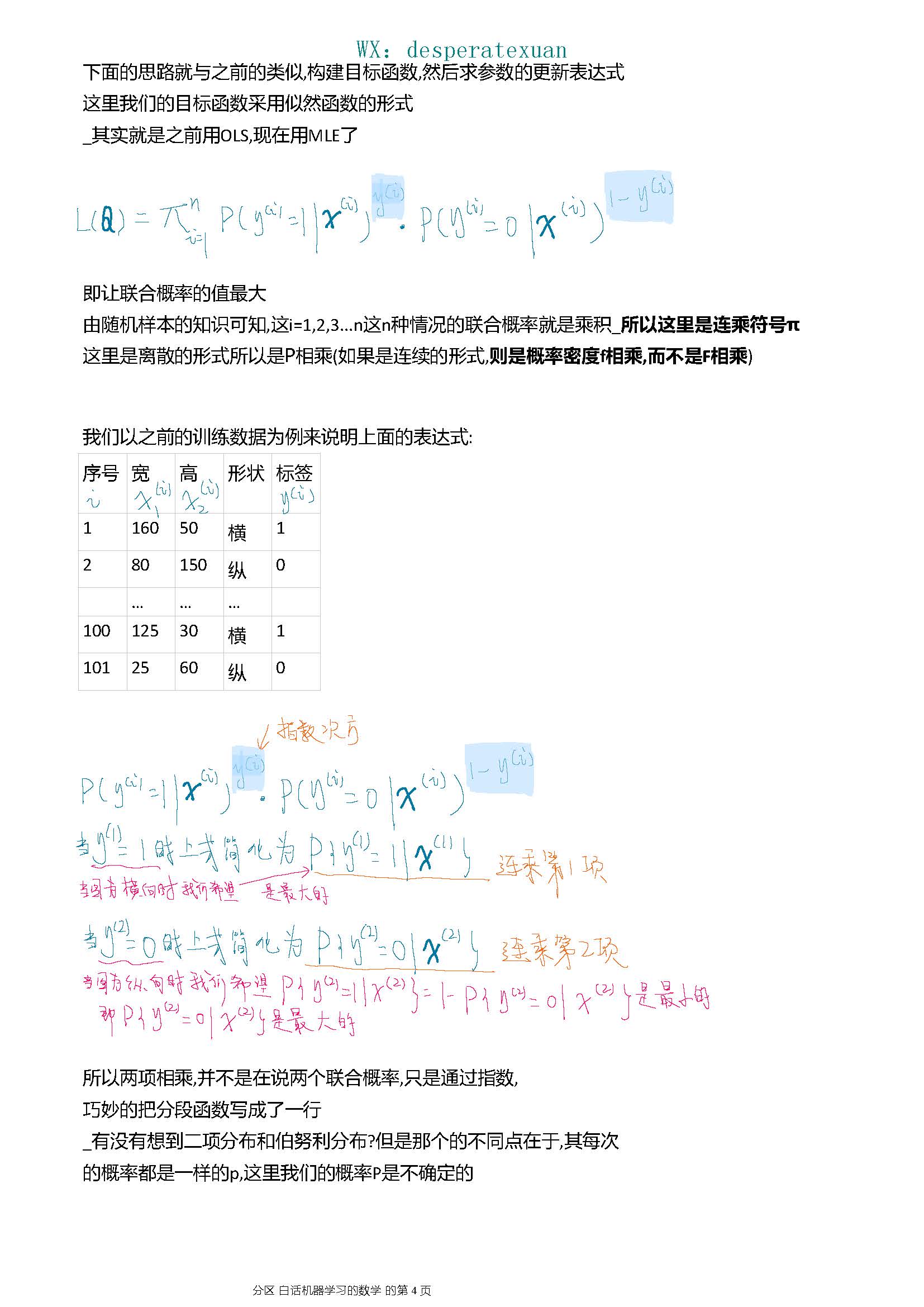

目录什么是回归算法线性回归似然函数/对数似然函数目标函数/损失函数常用的其他损失函数局部加权回归-损失函数线性回归的过拟合Ridge回归(岭回归)LASSO回归Elasitc Net算法(弹性网络算法)梯度下降算法批量梯度下降算法(BGD)随机梯度下降算法(SGD)小批量梯度下降法(MBGD)梯度下降法调优策略Logistic回归Softmax回归模型效果判断机器学习调参@(机器学习(2)之回归算法)什么是回归算法有监督算法解释变量(x)与观测值(因变量y)之间...