BP算法是关于误差的反向传播算法,就是从输出层开始,将结果与预期结果相比较,求出误差,然后按照梯度最大下降方向,调整神经元的联接权值,然后依次逐层调整各层之间的连接权值,对于批量学习方式而言,不断重复上述过程,直到误差达到足够小时为止。对于输出层而言,我们可以直接使用在上一篇博文中关于感知器模型的算法,BP算法的难点在于,如何处理隐藏层,因为隐藏层没有正确的输出信息用来计算误差。下面我们将从输出层开始...

这里介绍一些最新或者理解起来有一些难度的Nginx模块 一、secure_link_module模块作用原理:1、制定并允许检查请求的链接的真实性以及保护资源免遭未经授权的访问2、限制链接生效周期配置语法:secure_link expression;默认状态:-配置方法:http、server、location配置语法:secure_link_md5 expression;默认状态:-配置方法:http、server、location 二、secure_link模块实现请求资源验证首先确认安装的时候已经编译了此模块准备...

本篇主要讲述利用MTCNN的预训练模型得到原图中人脸的分割,代码如下:https://github.com/davidsandberg/facenet结合博客https://blog.csdn.net/FortiLZ/article/details/81396566?tdsourcetag=s_pctim_aiomsg看起来省力些要是对MTCNN的训练过程感兴趣的,可以看https://www.cnblogs.com/helloworld0604/p/9808795.htmlMTCNN原理经过P,R,O三层网络,一层层检测,具体网络构建如下:PNetclass PNet(Network):def setup(self):(sel...

from keras.layers import LSTM

model = Sequential()

model.add(embedding_layer)

model.add(LSTM(32))

#当结果是输出多个分类的概率时,用softmax激活函数,它将为30个分类提供不同的可能性概率值

model.add(layers.Dense(len(int_category), activation=softmax))#对于输出多个分类结果,最好的损失函数是categorical_crossentropy

model.compile(optimizer=rmsprop, loss=categorical_crossentropy, metrics=[accuracy])

histor...

一、获得了2017年《电子工业出版社》优秀作者

荣获电子工业出版社2017年度优秀作者

二、卖断货,连续第⑨次重印

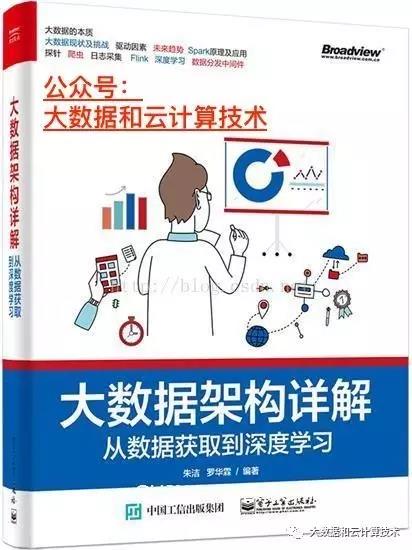

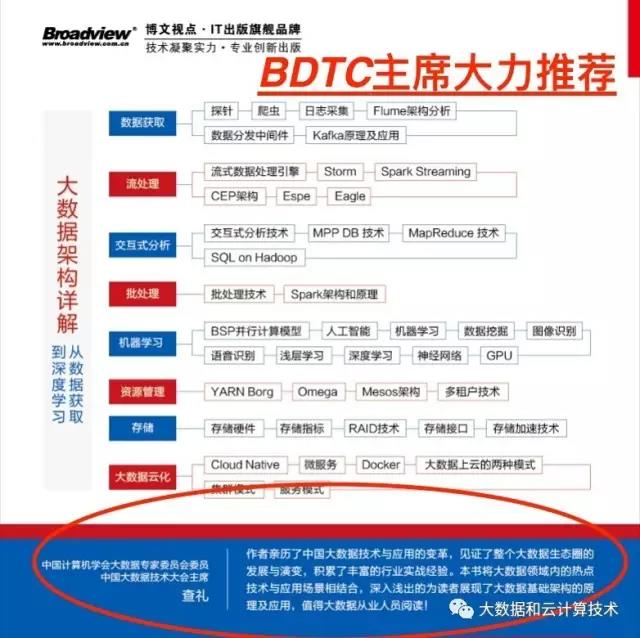

个人2016.10月出版的《大数据架构详解:从数据获取到深度学习》,卖的还不错,京东,当当,亚马逊一直在热销榜上,一直排在前列,榜首常客!连续卖断货,累计九次重印,重印新书已经上市。多谢大家支持,请大家继续帮忙宣传和推广,选购购买的同学记得好评,让更多同学了解。谢谢。

本书全网(京东、当当、淘宝、亚马逊...

实战场景 - 灰度发布

灰度发布的作用:按照一定的关系区别,分部分的代码进行上线,使代码的发布能平滑过渡上线实现方式: 1、用户的信息cookie等信息区别 2、根据用户的IP地址安装memcached:yum -y install memcached

准备好两个tomcat,9090代表生产环境,8080代表预发布环境为避免冲突,修改tomcat9090的端口号

这里分别在同个tomcat/webapp/ROOT/下放了同样内容的jsp文件

把8080下的jsp问价内容改一下区别于9090

<%...

下载:https://pan.baidu.com/s/12-s95JrHek82tLRk3UQO_w

更多资料分享:http://blog.51cto.com/3215120

《深度学习与计算机视觉 算法原理、框架应用》PDF,带书签,347页。《大数据架构详解:从数据获取到深度学习》PDF,带书签,373页。配套源代码。

《深度学习与计算机视觉 算法原理、框架应用》全书共13章,分为2篇,第1篇基础知识,第2篇实例精讲。用通俗易懂的文字表达公式背后的原理,实例部分提供了一些工具,很实用。《...

激活函数是什么激活函数,即Activation Function,有时候也称作激励函数。它是为了解决线性不可分的问题引出的。但是也不是说线性可分就不能用激活函数,也是可以的。它的目的是为了使数据更好的展现出我们想要的效果。激活函数在哪里用?比如一个神经网络为了更清晰的表示,我用红色标出。比如像上面的网络z = W*x,这个线性运算就是上面节点白色的部分,另一部分当然就是F(z)了。则第一层隐层(除了输入和输出层,其他都为隐层,因...

概括 大体上简单的卷积神经网络是下面这个网络流程:笼统的说: 文本通过Embeding Layer 后,再通过一些filters进行过滤,对结果进行maxPooling,再经过线性层映射到类别上,最后经过Softmax,得出类别分数。细致的说: 就得慢慢分析了,as follows:第一层:将Embeding进行filter 设 Embeding大小为:EmbedSize 边解释专有名词边讲述过程: Channel: 每个单词的向量是上图的对应的行。这里的一个句子形成...