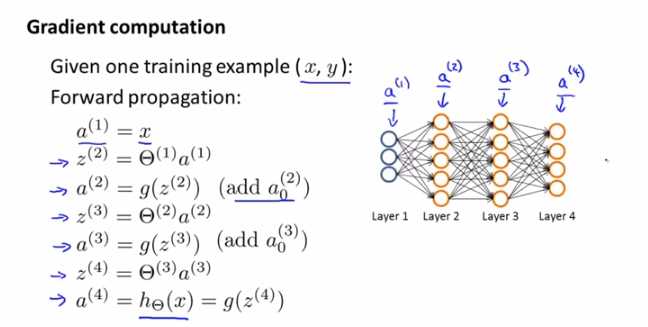

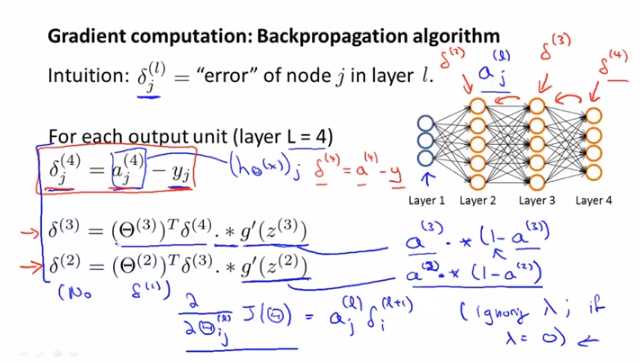

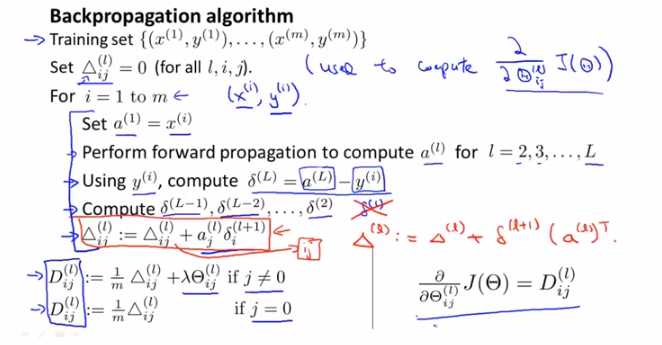

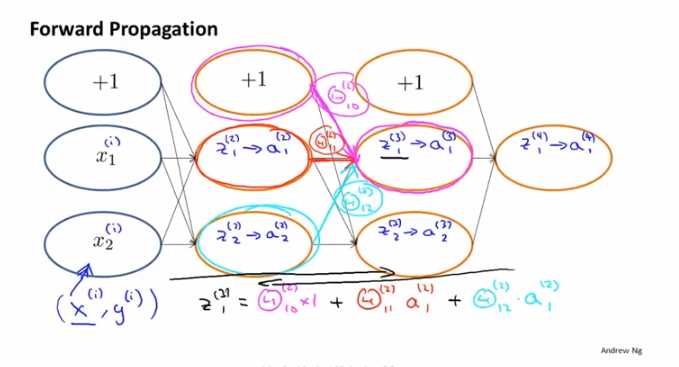

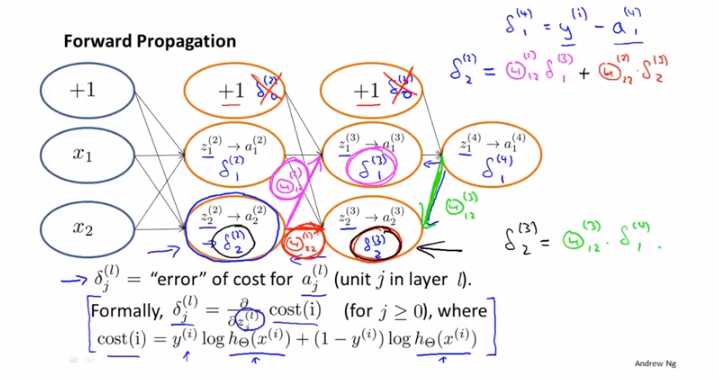

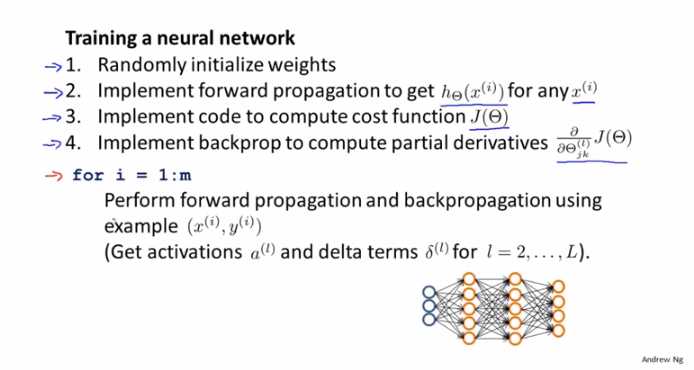

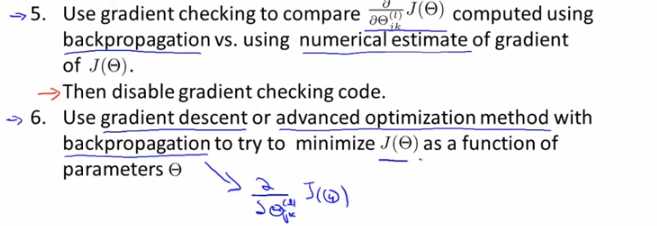

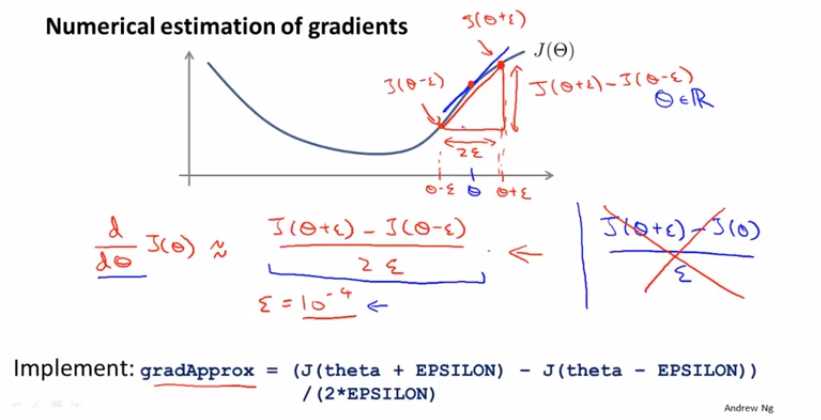

本篇讲述了神经网络的误差反向传播以及训练一个神经网络模型的流程更多内容参考 机器学习&深度学习神经网络可以理解为两个过程:信号的正向传播和误差的反向传播。在正向的传播过程中,计算方法为Sj=wijxi+bj,其中i是样本、j是层数。然后xj=f(Sj),f为激活函数。引入激活函数的原因是可以带来一定的非线性特性。由于样本的y是在最后一层输出的,因此在计算误差的时候,需要从最后一层开始计算、针对与之关联的参数进行求梯度,获得...

1、def add_layer()添加神经网络层: import tensorflow as tfdef add_layer( inputs, in_size, out_size ,activation_function=None) :#weight初始化时生成一个随机变量矩阵比0矩阵效果要好Weights = tf.Variable( tf.random_normal ( [in_size, out_size]))#biases初始值最好也不要都为0,则biases值全部等于0.1biases = tf.Variable( tf.zeros([1,out_size]) + 0.1) #相当于Y_predictWx_plus_b = tf.matmul ( inputs,Weights ) ...

Long time no see~更新一波:原文:https://www.cnblogs.com/Ann21/p/12266966.html

1. RNN首先思考这样一个问题:在处理序列学习问题时,为什么不使用标准的神经网络(建立多个隐藏层得到最终的输出)解决,而是提出了RNN这一新概念?

标准神经网络如下图所示:标准神经网络在解决序列问题时,存在两个问题:难以解决每个训练样例子输入输出长度不同的情况,因为序列的长度代表着输入层、输出层的维度,不可能每训练一个样例就改变一次网络结构。标准的神经网络不能共享从文本不同位置上学到的特征。举例说明:如果...

1.通常神经认知机包含两类神经元,即承担特征抽取的S-元和抗变形的C-元。S-元中涉及两个重要参数,即感受野与阈值参数,前者确定输入连接的数目,后者则控制对特征子模式的反应程度。在传统的神经认知机中,每个S-元的感光区中由C-元带来的视觉模糊量呈正态分布,也就是说如果眼睛感受到物体是移动的,即已感受到模糊和残影,S-感光区会调整识别模式,这时它不会完整地提取所有的特征给大脑而是只获取一部分关键特征,屏蔽其他的视...

前面已经使用TensorFlow2的原生代码搭建神经网络,接下来将使用keras搭建神经网络,并改写鸢尾花分类问题的代码,将原本100多行的代码用不到20行代码实现。用TensorFlow API:tf.keras搭建网络使用Sequential六步法:import,相关模块train, test,指定训练集的输入特征,和训练集的标签model = tf.keras.models.Sequential,搭建网络结构,(顺序神经网络)model.compile,配置训练方法model.fit,执行训练model.summary,打印出网...

竞争神经网络学习竞争型神经网络是基于无监督学习(Unsupervised learning)方法的神经网络的一种重要类型,它经常作为基本的网络形式,构成其它一些具有自组织能力的网络,如自组织映射网络(SOM)、自适应共振理论网络、学习向量量化网络等。生物神经网络存在一种侧抑制的现象,即一个神经细胞兴奋后,通过它的分支会对周围其他神经细脑产生抑制,这种抑制使神经细胞之间出现竞争:在开始阶段,各神经元对相同的输入具有相同的响...

一、卷积卷积神经网络(Convolutional Neural Networks)是一种在空间上共享参数的神经网络。使用数层卷积,而不是数层的矩阵相乘。在图像的处理过程中,每一张图片都可以看成一张“薄饼”,其中包括了图片的高度、宽度和深度(即颜色,用RGB表示)。在不改变权重的情况下,把这个上方具有k个输出的小神经网络对应的小块滑遍整个图像,可以得到一个宽度、高度不同,而且深度也不同的新图像。卷积时有很多种填充图像的方法,以下主要介...

我们在计算模型w的转置乘上x的时候,往往需要把w和x分别进行向量化然后运算,因为这样会使我们的计算机得到结果的时间更快,而且这种方法不管是在CPU还是在GPU上都是成立的,首先我们来看看代码:import numpy as np

import time

a=np.random.rand(1000000)

b=np.random.rand(1000000)

toc=time.time()

c=np.dot(a,b)

tic=time.time()

print("向量化之后计算的时间为:"+str(1000*(tic-toc))+"ms")

c=0

tic=time.time()

for i in r...

具体原理网址:http://wenku.baidu.com/link?url=zSDn1fRKXlfafc_tbofxw1mTaY0LgtH4GWHqs5rl8w2l5I4GF35PmiO43Cnz3YeFrrkGsXgnFmqoKGGaCrylnBgx4cZC3vymiRYvC4d3DF3自组织特征映射神经网络(Self-Organizing Feature Map。也称Kohonen映射),简称为SMO网络,主要用于解决模式识别类的问题。SMO网络属于无监督学习算法,与之前的Kmeans算法类似。所不同的是,SMO网络不需要预先提供聚类的数量,类别的数量是由网络自动识别出来的。...

转自 http://blog.csdn.net/xingzhedai/article/details/53144126更多参考:http://blog.csdn.net/mafeiyu80/article/details/51446558http://blog.csdn.net/caimouse/article/details/70225998http://kubicode.me/2017/05/15/Deep%20Learning/Understanding-about-RNN/RNN(Recurrent Neuron Network)是一种对序列数据建模的神经网络。继Bengio提出基于神经网络的概率语言模型并获得成功之后,Mikolov于2010年提出利用RNN建模语言模...

1 from keras.datasets import mnist2 from keras.utils import to_categorical3 4 #1. 获取数据5 (train_images, train_labels), (test_images, test_labels) = mnist.load_data()6 7 #2. 处理数据8 train_images = train_images.reshape((60000, 28, 28, 1))9 train_images = train_images.astype(float32) / 255

10

11 test_images = test_images.reshape((10000, 28, 28, 1))

12 test_images = test_images.astype(float32) /...

http://www.ai-start.com/dl2017/html/lesson1-week2.html神经网络的编程基础(Basics of Neural Network programming)

二分类(Binary Classification)

我们来看看一张图片在计算机中是如何表示的,为了保存一张图片,需要保存三个矩阵,它们分别对应图片中的红、绿、蓝三种颜色通道,如果你的图片大小为64x64像素,那么你就有三个规模为64x64的矩阵,分别对应图片中红、绿、蓝三种像素的强度值。为了便于表示,这里我画了三个很小的...

原书地址:https://zh-v2.d2l.ai/chapter_preliminaries/lookup-api.html

预备知识

背景:所有的机器学习方法都涉及从数据中提取信息。因此,我们首先将学习一些实用技能,包括存储、操作和预处理数据。

机器学习通常需要处理大型数据集。我们可以将数据集视为表,其中表的行对应于样本,列对应于属性。将重点放在矩阵运算的基本原理及其实现上。

深度学习是关于优化的。我们有一个带有参数的模型,我们想要找到那些能拟合数据的最...

6.3循环神经网络的高级用法

在这一节中,我们将回顾三种先进技术来提高递归神经网络的性能和泛化能力。在本节结束时,您将了解关于使用Keras的递归网络所知道的大部分内容。我们将展示一个天气预报问题的所有三个概念,在那里我们可以访问来自安装在建筑物屋顶上的传感器的数据点的时间,例如温度、气压和湿度,我们用来预测在收集最后一个数据点后24小时的温度。这是一个相当具有挑战性的问题,举例说明了在使用时间序列时遇到的许...